GeoWerkstatt-Projekt des Monats Mai 2022

Projekt: Autonomes Navigieren mit einem digitalen Gebäudemodell

Forschende: Arman Khami

Projektidee: Zentimetergenaue Bestimmung der Flugtrajektorie eines unbemannten Luftfahrzeugs (UAV).

Die Geschichte der Ortung und Navigation reicht sehr weit in die Geschichte der Menschheit zurück. Vor einigen tausend Jahren konnte man seinen Standort und sein Ziel finden, indem man die Sonne oder die Sterne beobachtete. Vor einigen hundert Jahren konnte man dank neuer und präziser Instrumente und genialer mathematischer und geometrischer Modelle die Position des Menschen bereits mit einer Genauigkeit von wenigen Zentimetern in einem festgelegten globalen Koordinatensystem bestimmen. Mit Hilfe der gleichen Instrumente und Messungen wurden Karten erstellt. Das war ein Meilenstein: Jeder, der eine solche Karte besaß, konnte nun seinen Standort bestimmen, indem er einfach die Karte und die Umgebung betrachtete. Diese Art der Navigation war bis vor 20 Jahren, als das globale Satellitennavigationssystem (GNSS) der Öffentlichkeit zugänglich gemacht wurde, sehr verbreitet. Heutzutage muss niemand mehr in die Sterne schauen, um seinen Weg zu finden - es sei denn, das GPS-Gerät oder das Smartphone haben keinen Strom mehr.

Aber die Geschichte der Navigation ist damit noch nicht zu Ende. Heute stellt sich die Frage: Wie kann Navigieren ohne Menschen, also ganz autonom funktionieren? Denn das kann – wenn alles richtiggemacht wird - bequemer, kostengünstiger und sogar sicherer sein.

Was ist für das autonome Navigieren nötig?

Natürlich braucht man ein Auge, um die Umgebung zu sehen. Vielleicht braucht man auch ein Gerät, das die Entfernungen direkt messen kann, um Kollisionen zu vermeiden. Man braucht GPS, um zu wissen, wo auf der Welt man sich überhaupt befindet. Ein Gehirn, das für einen denkt. Und schließlich den letzten und wichtigsten Schritt: eine starke und robuste Logik, die die Beobachtungen kombinieren und interpretieren kann und sagt, wo man sich befindet oder in welche Richtung man gehen sollte, um sein Ziel zu erreichen.

©

GIH

©

GIH

In diesem Projekt wollen wir ein unbemanntes Luftfahrzeug (UAV) wie in Abbildung 1 in einem städtischen Gebiet navigieren. Auf dieser UAV sind zwei Kameras und ein Laserscanner und ein Bordcomputer installiert. Theoretisch kann man mit diesen drei Elementen und einem mathematischen Modell die Flugbahn (Trajektorie) der UAV auf den Dezimeter genau bestimmen, indem man einfach die Umgebung beobachtet. Für das autonome Navigieren reicht das aber noch nicht. Denn diese Flugbahn könnte überall sein - in Hannover oder in einem anderen Teil der Welt. Anders gesagt: Die Flugbahn ist relativ zur Umgebung und die absolute Position der Flugbahn ist immer noch unklar. Eine einfache Lösung wäre, das GNSS als vierten Sensor in unserer Multi-Sensor-Plattform zu verwenden. Aber gerade in Städten ist nicht immer gewährleistet, dass das GNSS-Signal zu jeder Zeit verfügbar ist. Hindernisse wie Gebäude können einen Signalverlust verursachen.

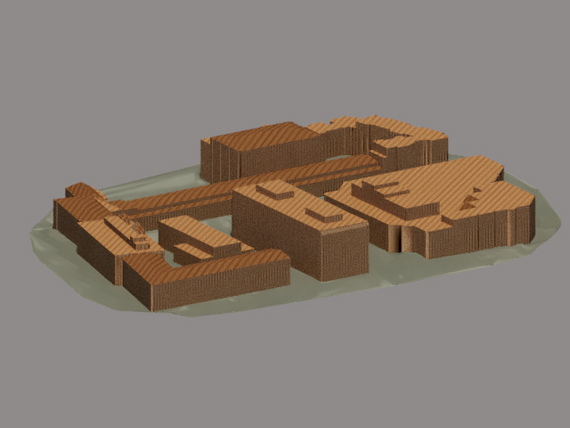

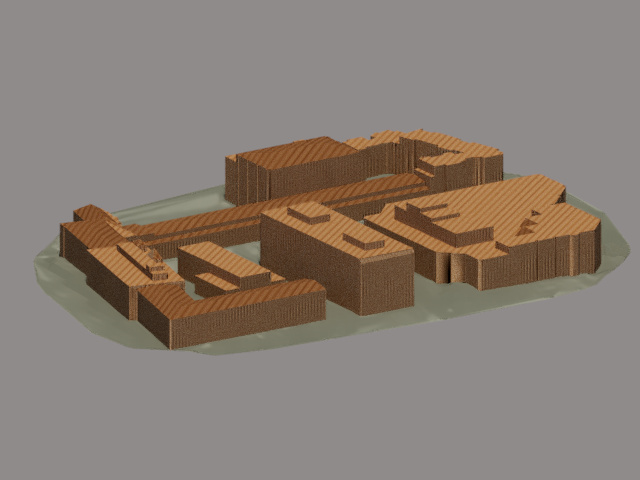

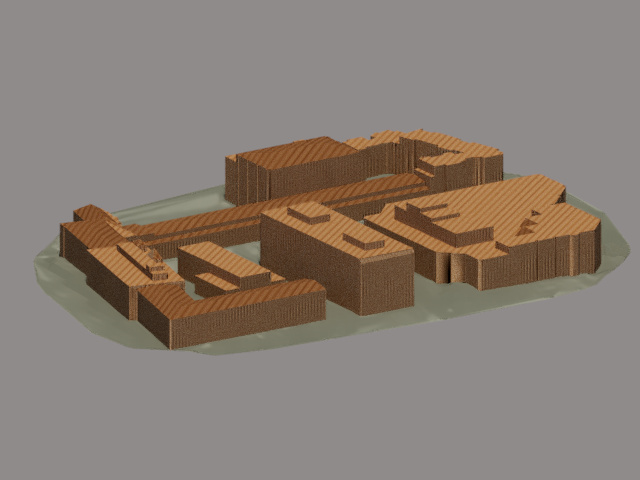

Zum Glück gibt eine weitere Möglichkeit, die absolute Trajektorie des UAVs ohne GPS zu bestimmen: Wenn wir die absolute oder globale Position und Ausrichtung der statischen Objekte kennen, die wir mit Hilfe der Sensoren beobachten, und wir unsere Flugbahn in Bezug auf diese bekannten Informationen bestimmen, ist das Endergebnis die absolute Trajektorie des UAVs im globalen Koordinatensystem. In einem Stadtgebiet wird diese Information als digitales Gebäudemodell bezeichnet. Man kann hier auf die Lage und Ausrichtung der Gebäude Bezug nehmen. Ein Beispiel für das digitale Gebäudemodell ist in Abbildung 2 dargestellt.

©

GIH

©

GIH

Wie sieht nun das mathematische Modell aus, das wir hier einsetzen, und wie sollten wir die Sensordaten kombinieren?

Wir verwenden einen Ansatz, der Filterung genannt wird. Die Filterung ist eine mathematische und statistische rekursive Schätzung, die für jeden einzelnen Moment der Zeit zwei Schritte umfasst.

Schritt 1: ist ein Vorhersageschritt, bei dem die unbekannten Parameter auf der Grundlage anfänglicher und ungefährer Informationen wie Geschwindigkeit, Beschleunigung und Winkelgeschwindigkeit um drei Achsen sowie der Startposition vorhergesagt werden.

Schritt 2: wird Korrektur genannt, was bedeutet, dass die vorhergesagten unbekannten Parameter korrigiert werden. Diese Korrektur erfolgt auf der Basis der Beobachtung der Sensoren und der mathematischen Beziehung zwischen Beobachtung und unbekannten Parametern.

Neben der Schätzung der Parameter ist es auch möglich, die Qualität der geschätzten Parameter zu berechnen, sodass wir uns auf die vorhergesagten und korrigierten unbekannten Parameter im Verhältnis zu ihrem Genauigkeitsgrad verlassen können.

Nach diesen zwei Schritten werden die Position und die Orientierung des nächsten Zeitabschnitts geschätzt, wobei die Vorhersage des neuen Zeitabschnitts von den Endergebnissen des vorherigen Schritts beeinflusst wird. Deshalb spricht man von einer rekursiven Schätzung.

Was wurde bisher in diesem Projekt gemacht und was sollte weiter getan werden?

In Schritt zwei der Filterung haben wir über die Korrektur der vorhergesagten Parameter anhand von Sensorbeobachtungen gesprochen. In diesem Projekt haben wir bisher nur die Beobachtungen des Laserscanners für den Korrekturschritt verwendet. Anders gesagt, wir haben die Flugtrajektorie nur auf Basis der Laserscannerdaten mit einer Genauigkeit im Dezimeterbereich geschätzt. Der nächste Schritt ist die Flugtrajektorie mit den Beobachtungen von Laserscanner und Kamera zu schätzen und die Verbesserung der Flugbahn nach Integration der Kameradaten zu untersuchen.