GeoWerkstatt-Projekt des Monats Januar 2019

Projekt: Echtzeitfähige, hochfrequente, zentimetergenaue und integrierte Bestimmung der Flugtrajektorie eines UAS mittels Kombination von Laserscanner- und Kameradaten sowie der Integration von Objektinformation.

Forschende: Johannes Bureick, Jakob Unger

Projektidee: Positionierung eines UAV anhand von Laserscanner- und Kameramessungen zu einem generalisierten Gebäudemodell

Wer kennt es nicht? Ihr seid zum ersten Mal in einer fremden Stadt, verlasst euer Hotelzimmer und wollt los zum Sightseeing. Was ist das Erste, was ihr macht? Na klar, Smartphone aus der Tasche und die Navigations-App eingeschaltet! Die App weiß, wo ihr seid, und, wenn ihr es eingetippt habt, auch wo ihr hinwollt. Los geht’s! Die App navigiert euch sicher zu eurem Ziel und lange bevor ihr da seid, könnt ihr euer Ziel auch schon sehen. Für uns Menschen ist es nicht so wichtig, ob die Navigations-App unseren Standpunkt nun um 5 m in die eine oder die andere Richtung verschoben anzeigt, wir finden uns meistens trotzdem zurecht. Auch ist es nicht schlimm, wenn der GPS-Empfang mal kurz abreißt. Nach ein paar Augenblicken oder ein paar Schritten in eine Richtung ist er ja meist wieder da.

Für einen Multikoper, auch als Unmanned Aerial Vehicle, kurz UAV, bezeichnet, ist dies aber nicht ausreichend. Fällt das GPS plötzlich aus oder zeigt eine falsche Position an, kann es zu einem Crash kommen. Gerade in der Stadt mit hohen Gebäuden und Bäumen ist der GPS-Empfang nicht optimal.

In dem oben genannten Projekt arbeiten wir daran, das beschriebene Szenario zu beherrschen und unser UAV auch ohne GPS-Empfang zuverlässig im Raum zu positionieren.

Und wie machen wir das?

Unser geplantes UAV ist mit verschiedenen Sensoren ausgestattet: neben einem GPS-Empfänger und einer Intertialen Messeinheit fliegen ein Laserscanner und mehrere Kameras mit. Der Laserscanner und die Kameras erfassen kontinuierlich die Umgebung.

Wie hilft uns das bei der Navigation?

In der Stadt Hannover (und auch in anderen Städten) stellt die Stadtverwaltung ein digitales 3D-Stadtmodell (Gebäudemodell) der gesamten Stadt zur Verfügung (siehe: Gebäudemodell Hannover). In diesem Gebäudemodell sind fast alle Gebäude der Stadt Hannover dargestellt.

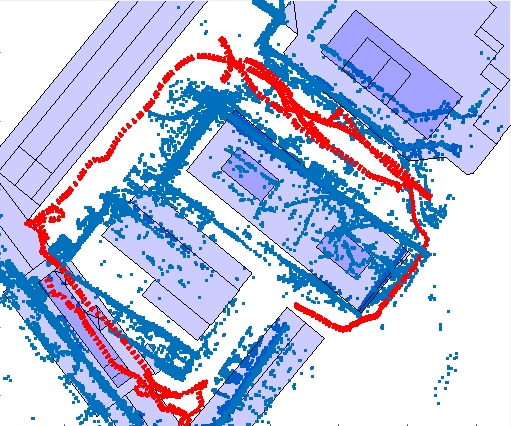

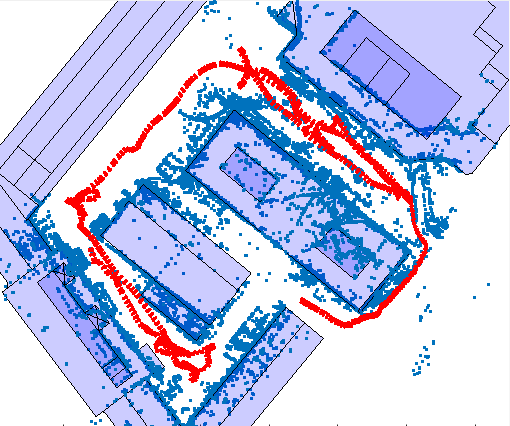

Messen nun die Kameras und der Laserscanner den Abstand zu einem dieser Gebäude, können wir darüber berechnen, wo sich unser UAV gerade befindet und wohin es ausgerichtet ist. Die Berechnung der Position und Ausrichtung erfolgt in zwei methodischen Ansätzen: Zum einen entwickeln wir eine sogenannte Bündelausgleichung. Diese Methode stammt aus der Photogrammetrie, wo sie genutzt wird, um aus Bildern 3D-Information und auch die Position und Ausrichtung der Kamera abzuleiten. In unserem Projekt werden wir sowohl die Laserscannermessungen als auch die Informationen des Gebäudemodells in die Bündelausgleichung integrieren. Zum anderen entwickeln wir ein sogenanntes Filter, das dazu da ist, die Messungen verschiedenster Sensoren so zu kombinieren. So können wir bestimmen, wo sich unser System (z.B. UAV) gerade befindet, wie schnell es unterwegs ist und wie es ausgerichtet ist. Diese Methodik wird häufig für die Navigation genutzt. Während die Integration der Laserscannermessungen in das Filter bereits bekannt ist, integrieren wir im Zuge des Projektes zusätzlich die Kameramessungen und die Informationen des Gebäudemodells. Das folgende Video zeigt die Positionierung des UAV, wenn ausschließlich Laserscannermessungen und ein Gebäudemodell verwendet werden. Die Abbildungen 1 und 2 zeigen erste Ergebnisse per Kamera. An der jeweiligen Kombination beider Sensoren arbeiten wir!